Historia SEO – od katalogów stron do AI w wyszukiwarkach

Historia SEO to fascynująca podróż od prostych katalogów stron internetowych po zaawansowane algorytmy wykorzystujące sztuczną inteligencję. To opowieść o ewolucji technologii, zmieniających się strategiach marketingowych i nieustającej walce między optymalizatorami a wyszukiwarkami o jak najlepszą widoczność w internecie.

Prehistoria internetu i pierwsze wyszukiwarki (lata 90.)

Katalogi stron – przed erą algorytmów

Zanim pojawił się Google, internet był miejscem znacznie bardziej chaotycznym. Pierwsze próby uporządkowania sieci opierały się na katalogach stron – ręcznie tworzonych bazach danych z linkami do witryn pogrupowanych tematycznie.

Najpopularniejszymi katalogami były:

- Yahoo! Directory (1994) – pierwszy masowy katalog, gdzie redaktorzy ręcznie dodawali i kategoryzowali strony

- DMOZ (Open Directory Project) (1998) – społecznościowy katalog tworzony przez wolontariuszy

- LookSmart – komercyjny katalog kierunkowy

Zarejestrowanie strony w takich katalogach było pierwszą formą „optymalizacji” – webmasterzy musieli wybierać odpowiednią kategorię i przygotowywać atrakcyjny opis swojej witryny. To właśnie wtedy narodziły się podstawy tego, co dziś znamy jako meta description.

Pierwsze wyszukiwarki algorytmiczne

W 1994 roku pojawiły się pierwsze wyszukiwarki wykorzystujące algorytmy do indeksowania stron:

WebCrawler – pierwsza wyszukiwarka indeksująca pełną treść dokumentów Lycos – wprowadzał ranking oparty na liczbie wystąpień słowa kluczowego AltaVista (1995) – przełom w technologii wyszukiwania, oferująca zaawansowane opcje wyszukiwania

Te wczesne wyszukiwarki działały na prostych zasadach. Algorytmy wyszukiwarek opierały się głównie na:

- Częstotliwości występowania słów kluczowych w tekście

- Umieszczeniu słów kluczowych w tagach meta

- Liczbie słów na stronie

To sprawiło, że pozycjonowanie było względnie proste – wystarczyło wielokrotnie powtórzyć słowo kluczowe, by osiągnąć wysokie pozycje. Niestety, prowadziło to do masowego spamu i degradacji jakości wyników wyszukiwania.

Era Google i rewolucja PageRank (1998-2003)

Narodziny Google i PageRank

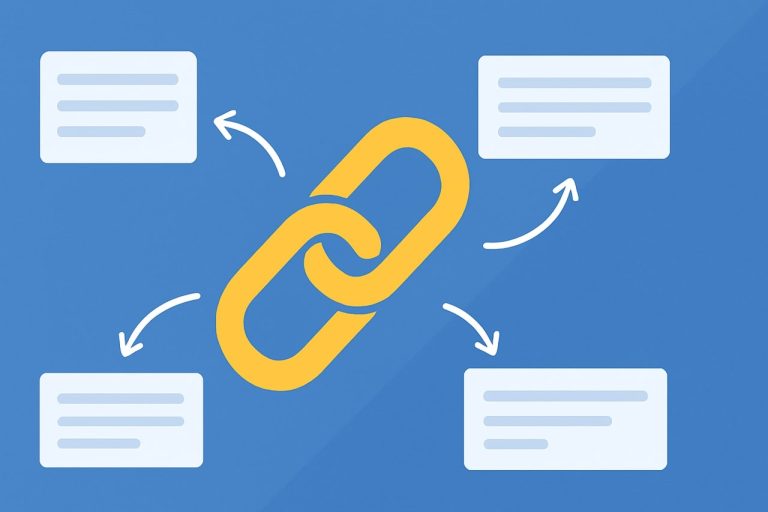

W 1998 roku Larry Page i Sergey Brin uruchomili wyszukiwarkę, która miała zmienić internet na zawsze. Google wprowadził rewolucyjny algorytm PageRank, który oceniał strony nie tylko na podstawie ich treści, ale przede wszystkim na podstawie linków zwrotnych.

Koncepcja była prosta, ale genialna: jeśli wiele stron linkuje do Twojej witryny, prawdopodobnie oferujesz wartościową treść. Co więcej, linki z autorytatywnych stron miały większą wagę niż te z mniej znaczących witryn.

To był prawdziwy przełom. Nagle link building stał się kluczowym elementem SEO. Webmasterzy zaczęli aktywnie pozyskiwać linki, co doprowadziło do rozwoju różnych strategii linkowania zewnętrznego.

Pierwsze próby manipulacji

Wraz z rosnącą popularnością Google, SEO specjaliści zaczęli odkrywać sposoby na manipulację algorytmem. Popularne stały się techniki dziś klasyfikowane jako Black Hat SEO:

Keyword stuffing – nadmierne nasycanie tekstu słowami kluczowymi Ukryte teksty – biały tekst na białym tle lub tekst wielkości 0px Cloaking – pokazywanie robotom innej treści niż użytkownikom Link farms – sieci stron wzajemnie się linkujących wyłącznie w celu manipulacji PageRank Doorway pages – strony bramkowe stworzone tylko dla robotów

Jakość wyników wyszukiwania zaczęła spadać, co zmusiło Google do działania. Jak działała wyszukiwarka Google w tamtych czasach, było stosunkowo łatwe do zrozumienia i manipulacji.

Google Florida Update (2003)

W listopadzie 2003 roku Google wypuścił aktualizację Florida – pierwszy poważny update algorytmu, który zrewolucjonizował SEO. Wiele stron stosujących agresywne techniki Black Hat SEO zostało praktycznie usunięte z wyników wyszukiwania.

To był wyraźny sygnał: era prostych manipulacji dobiega końca. Google rozpoczął walkę ze spamem, która trwa do dziś.

Walka ze spamem i profesjonalizacja SEO (2004-2010)

Era wielkich aktualizacji

Lata 2004-2010 to okres intensywnego rozwoju algorytmów Google i profesjonalizacji branży SEO. Pojawiły się narzędzia, agencje i cała infrastruktura wspierająca optymalizację stron.

Google Panda (2011, ale prace rozpoczęto wcześniej)

Update Panda zmienił sposób oceny jakości treści. Google zaczął karać strony z:

- Thin content – płytkimi, mało wartościowymi treściami

- Duplikatami treści

- Nadmierną liczbą reklam

- Niską jakością redakcyjną

To był moment, w którym content marketing stał się kluczowy dla SEO. Jakość treści zaczęła przeważać nad sztuczkami technicznymi.

Google Penguin (2012)

Aktualizacja Penguin skupiła się na jakości profilu linkowego. Google zaczął karać za:

- Nienaturalne teksty kotwic

- Linki z sieci prywatnych blogów (PBN)

- Link farming

- Masową wymianę linków

Wiele firm, które opierały swoje strategie na agresywnym budowaniu linków, straciło pozycje z dnia na dzień. Branża SEO musiała się przeorientować na White Hat SEO i naturalne pozyskiwanie linków.

Rozwój narzędzi SEO

Wraz z komplikacją algorytmów rozwijały się narzędzia wspierające pracę SEO:

Wczesne narzędzia analityczne:

- Google Analytics (2005) – rewolucja w analityce webowej

- Google Search Console (dawniej Webmaster Tools) – bezpośrednie okno do Google

- Ahrefs (2011) – zaawansowana analiza linków

- SEMrush (2008) – kompleksowe narzędzie do analizy konkurencji

Polskie narzędzia jak Senuto pojawiły się nieco później, dostosowane do specyfiki polskiego rynku.

Rosnące znaczenie treści

W tym okresie narodziło się powiedzenie „Content is King”. Webmasterzy zrozumieli, że długoterminowy sukces w SEO wymaga:

- Regularnego publikowania wartościowych treści

- Budowania autorytetu tematycznego

- Tworzenia treści evergreen

- Angażowania użytkowników

Jak pisać treści zgodne z SEO, ale przyjazne dla ludzi stało się kluczowym pytaniem branży.

Era semantyczna i mobile (2011-2015)

Google Hummingbird – semantyczna rewolucja

W 2013 roku Google wprowadził update Hummingbird, który fundamentalnie zmienił sposób interpretowania zapytań użytkowników. Zamiast koncentrować się na pojedynczych słowach kluczowych, Google zaczął rozumieć kontekst i intencję wyszukiwania.

Kluczowe zmiany:

- Rozumienie zapytań naturalnych (konwersacyjnych)

- Analiza semantycznego znaczenia fraz

- Uwzględnienie synonimów i powiązanych konceptów

- Lepsze dopasowanie wyników do intencji wyszukiwania

To była odpowiedź na rosnącą popularność dłuższych, bardziej naturalnych zapytań. Research słów kluczowych musiał uwzględnić nie tylko exact match, ale całe grupy semantyczne.

Mobilegeddon – mobilna rewolucja

21 kwietnia 2015 roku Google wypuścił Mobilegeddon – aktualizację, która faworyzowała strony zoptymalizowane pod urządzenia mobilne. To był przełomowy moment, bo po raz pierwszy Google tak wyraźnie komunikował nadchodzące zmiany.

Strony niemobilne zaczęły tracić pozycje w wynikach wyszukiwania mobilnego. To zmusiło całą branżę do przeprojektowania milionów witryn i przyjęcia podejścia mobile-first.

Kluczowe koncepcje tego okresu:

- Responsive web design

- Mobile-first design

- Optymalizacja szybkości ładowania na urządzeniach mobilnych

- Uproszczenie nawigacji dla małych ekranów

RankBrain – pierwsze AI w Google

W 2015 roku Google wprowadził RankBrain – pierwszy system wykorzystujący uczenie maszynowe do interpretowania zapytań i oceny wyników. RankBrain pomagał Google lepiej rozumieć:

- Nowe, nieznane wcześniej zapytania

- Niejednoznaczne intencje użytkowników

- Kontekst lokalny i osobisty

- Sygnały behawioralne użytkowników

To był pierwszy krok w kierunku prawdziwej sztucznej inteligencji w wyszukiwarce.

Epoka doświadczenia użytkownika (2016-2019)

Medic Update i narodziny E-A-T

W sierpniu 2018 roku Google wypuścił Medic Update, który szczególnie dotknął strony z kategorii YMYL (Your Money or Your Life) – czyli witryny medyczne, finansowe i prawne.

Update wprowadził koncepcję E-A-T (Expertise, Authoritativeness, Trustworthiness), która następnie ewoluowała do E-E-A-T (dodając Experience – doświadczenie):

Expertise (Ekspertyza) – czy autor treści jest ekspertem w danej dziedzinie Experience (Doświadczenie) – czy autor ma praktyczne doświadczenie w temacie Authoritativeness (Autorytet) – czy witryna i autor są uznawani za autorytety Trustworthiness (Wiarygodność) – czy można ufać informacjom na stronie

To był sygnał, że autorytet strony i wiarygodność stają się kluczowe, szczególnie w branżach wpływających na zdrowie i finanse ludzi.

BERT – rozumienie języka naturalnego

W 2019 roku Google wprowadził BERT (Bidirectional Encoder Representations from Transformers) – przełomowy model przetwarzania języka naturalnego. BERT pozwalał Google na:

- Zrozumienie kontekstu słów w zdaniu

- Interpretację niuansów językowych

- Rozpoznawanie relacji między słowami

- Lepsze dopasowanie wyników do intencji

Dla SEO oznaczało to, że optymalizacja pod pojedyncze słowa kluczowe traci sens. Trzeba było skupić się na tworzeniu treści naturalnie odpowiadających na pytania użytkowników i rozumiejących intencję użytkownika.

Core Web Vitals – UX jako czynnik rankingowy

Google zaczął coraz bardziej podkreślać znaczenie doświadczenia użytkownika (UX). W 2020 roku ogłoszono wprowadzenie Core Web Vitals – zestawu metryk mierzących jakość doświadczenia użytkownika:

LCP (Largest Contentful Paint) – szybkość ładowania głównej treści FID (First Input Delay) – responsywność strony CLS (Cumulative Layout Shift) – stabilność wizualna

Te metryki stały się oficjalnymi czynnikami rankingowymi w 2021 roku. Szybkość ładowania strony nie była już tylko kwestią wygody użytkowników, ale wpływała bezpośrednio na pozycje w wyszukiwarce.

Rewolucja AI i nowa era SEO (2020-dziś)

Helpful Content Update – walka z contentem AI

W sierpniu 2022 roku Google wprowadził Helpful Content Update, skierowany przeciwko treściom tworzonym głównie dla wyszukiwarek, a nie dla ludzi. To była bezpośrednia odpowiedź na eksplozję treści generowanych przez AI.

Google zaczął promować strony, które:

- Tworzą treści z myślą o użytkownikach, nie robotach

- Oferują unikalne, ekspertowe perspektywy

- Prezentują oryginalne badania lub analizy

- Są tworzone przez ludzi z doświadczeniem w danej dziedzinie

To był wyraźny sygnał: jak sztuczna inteligencja wpływa na SEO i że Google nie toleruje masowo generowanych, płytkich treści.

ChatGPT i rosnące znaczenie AI w SEO

Premiera ChatGPT w listopadzie 2022 roku wywołała tsunami w branży content marketingu i SEO. Nagle każdy mógł generować tysiące artykułów dziennie. Pojawiły się pytania:

- Czy Google wykrywa treści AI?

- Jaka jest rola AI contentu w pozycjonowaniu?

- Czy można używać AI do tworzenia treści SEO?

Google zajął stanowisko: treści AI same w sobie nie są zakazane, ale muszą spełniać te same standardy jakości co treści pisane przez ludzi. Kluczowa stała się wartość dodana przez człowieka – edycja, weryfikacja, dodawanie unikalnych perspektyw.

Search Generative Experience (SGE) i AI Overviews

W 2023 roku Google rozpoczął testy SGE (Search Generative Experience), a następnie wprowadził AI Overviews – podsumowania wygenerowane przez AI, które pojawiają się na szczycie wyników wyszukiwania.

To fundamentalna zmiana w sposobie działania wyszukiwarki:

- Użytkownicy otrzymują bezpośrednie odpowiedzi bez konieczności klikania w wyniki

- Rośnie liczba zero-click searches

- Tradycyjny CTR spada

- Zmienia się sposób mierzenia sukcesu SEO

SEO w erze wyszukiwarek opartych na AI wymaga nowego podejścia. Trzeba myśleć nie tylko o pozycjach, ale o:

- Obecności w źródłach cytowanych przez AI

- Budowaniu autorytetu rozpoznawalnego przez modele językowe

- Tworzeniu treści, które AI uzna za wiarygodne

- Optymalizacji pod różne formaty odpowiedzi

Spam Updates i walka z parasite SEO

Google intensyfikuje walkę z nowymi formami spamu. W 2023 i 2024 roku wprowadzono serię aktualizacji wymierzonych w:

- Parasite SEO – wykorzystywanie autorytatywnych domen do publikacji niezwiązanych treści sponsorowanych

- Scaled content abuse – masowe generowanie treści niskiej jakości

- Site reputation abuse – nadużywanie reputacji witryny

Szczególnie istotny był Site Reputation Abuse Update z maja 2024, który uderzył w strony publikujące masowe treści sponsorowane, które nie są związane z głównym tematem witryny.

Współczesne SEO – co się liczy dzisiaj?

Wielowymiarowe podejście do optymalizacji

Współczesne SEO to nie pojedyncze działania, ale kompleksowa strategia obejmująca:

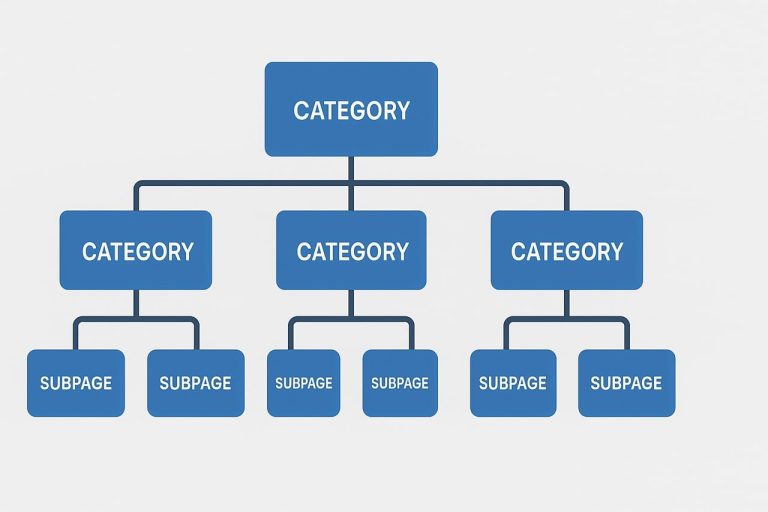

1. Techniczne fundamenty:

- Prawidłowe crawlowanie i indeksowanie

- Optymalna struktura URL

- Poprawne wykorzystanie tagów kanonicznych

- Zaawansowane dane strukturalne

- Zarządzanie plikiem robots.txt i sitemap XML

2. Jakość i ekspertyza treści:

- Treści oparte na E-E-A-T

- Oryginalne badania i dane

- Praktyczne doświadczenie autorów

- Dogłębne odpowiedzi na pytania użytkowników

- Blog firmowy jako narzędzie pozycjonowania

3. Doświadczenie użytkownika:

- Core Web Vitals na poziomie

- Intuicyjna nawigacja

- Przejrzysta struktura kategorii

- Mobile-first design

- Dostępność (accessibility)

4. Budowanie autorytetu:

- Naturalne pozyskiwanie wartościowych linków

- Strategiczne linkowanie wewnętrzne

- Obecność w mediach branżowych

- Social media a pozycjonowanie

Specjalizacja w SEO

Branża SEO stała się na tyle złożona, że pojawiły się wyraźne specjalizacje:

SEO techniczne – inżynierowie SEO zajmujący się architekturą stron, szybkością, crawl budget Content SEO – specjaliści od strategii treści i optymalizacji contentowej SEO lokalne – eksperci od Google Business Profile i widoczności lokalnej E-commerce SEO – specjaliści od sklepów internetowych Enterprise SEO – praca z ogromnymi korporacyjnymi witrynami SEO międzynarodowe – zarządzanie wielojęzycznymi i wielorynkowymi serwisami

Przyszłość SEO – dokąd zmierzamy?

Trend 1: Jeszcze więcej AI, ale z ludzkim dotykiem

AI będzie coraz bardziej obecne w procesie tworzenia treści i optymalizacji, ale kluczowe pozostanie:

- Ludzka weryfikacja i edycja

- Unikalne perspektywy oparte na doświadczeniu

- Oryginalność myślenia

- Budowanie prawdziwego autorytetu eksperckiego

Jak AI zmienia SEO to proces ciągły, a specjaliści SEO muszą nauczyć się współpracować z AI, nie konkurować z nim.

Trend 2: Multimodalne wyszukiwanie

Przyszłość należy do wyszukiwania wykraczającego poza tekst:

- Wyszukiwanie głosowe

- Wyszukiwanie obrazem (Google Lens)

- Wyszukiwanie wideo

- Multimodalne zapytania łączące różne media

Rola multimediów w SEO będzie rosła, a optymalizacja będzie musiała obejmować wszystkie formy treści.

Trend 3: Personalizacja i kontekst

Wyniki wyszukiwania będą coraz bardziej spersonalizowane na podstawie:

- Historii wyszukiwania użytkownika

- Lokalizacji i kontekstu czasowego

- Urządzenia i sposobu korzystania

- Preferencji i zachowań

SEO będzie musiało uwzględniać różnorodność wyników dla różnych segmentów użytkowników.

Trend 4: Autentyczność i transparentność

W erze deepfake’ów i masowo generowanych treści, Google będzie coraz mocniej promować:

- Zweryfikowanych autorów z prawdziwym doświadczeniem

- Transparentne źródła informacji

- Strony z jasną polityką redakcyjną

- Witryny pokazujące prawdziwych ludzi za marką

Trend 5: Integracja z platformami społecznościowymi

Granice między wyszukiwarkami a social media będą się zacierać:

- TikTok i Instagram jako alternatywne wyszukiwarki dla młodszych użytkowników

- Integracja wyników social media w SERP

- Znaczenie obecności marki na różnych platformach

Lekcje z historii SEO

Co się nie zmieniło przez lata?

Mimo ogromnych zmian technologicznych, niektóre zasady pozostają niezmienne:

1. Jakość ponad ilość Od Google Florida Update przez Pandę po Helpful Content – każdy wielki update przypomina, że jakość bije ilość.

2. Użytkownik na pierwszym miejscu Strony optymalizowane dla użytkowników, nie robotów, zawsze wygrywają długoterminowo. Czy SEO w 2025 roku jest trudne? Tak, ale podstawowa zasada pozostaje ta sama.

3. Skróty nie działają Black Hat SEO może przynieść krótkoterminowe rezultaty, ale długoterminowo zawsze prowadzi do porażki. Google jest coraz lepszy w wykrywaniu manipulacji.

4. SEO to maraton, nie sprint Dlaczego SEO to inwestycja długoterminowa? Odpowiedź nie zmieniła się od początku istnienia branży.

Co się zmieniło?

Złożoność – Współczesne SEO wymaga wiedzy z dziesiątek dziedzin: od programowania przez UX po psychologię użytkownika.

Szybkość zmian – Updates pojawiają się częściej, a ich wpływ jest trudniejszy do przewidzenia.

Znaczenie danych – Decyzje oparte na danych zastąpiły intuicję i zgadywanie.

Specjalizacja – Nie da się być ekspertem od wszystkiego. Skuteczne SEO wymaga zespołów specjalistów.

Podsumowanie

Historia SEO to opowieść o nieustannej adaptacji. Od prostych katalogów stron przez walkę z keyword stuffingiem, przez rewolucję mobile, aż po erę AI – branża musiała wielokrotnie się reinventować.

Dziś co to jest SEO to pytanie o wiele bardziej złożone niż 25 lat temu. To nie tylko „optymalizacja dla wyszukiwarek”, ale kompleksowa strategia cyfrowej obecności, obejmująca technologię, treść, user experience i budowanie autorytetu.

Przyszłość SEO będzie jeszcze bardziej zintegrowana z AI, jeszcze bardziej skoncentrowana na użytkowniku i jeszcze bardziej wymagająca pod względem jakości i autentyczności. Ale fundamenty pozostaną te same: twórz wartościowe treści, dbaj o użytkowników, buduj prawdziwy autorytet.

Jak długo trwa pozycjonowanie strony? Odpowiedź również się nie zmieniła – to proces długoterminowy, wymagający cierpliwości, konsekwencji i nieustannego uczenia się. Bo w świecie SEO jedyne pewne jest to, że wszystko się zmienia.

Najważniejsza lekcja z historii SEO? Adaptuj się albo giń. Ci, którzy potrafią przewidzieć trendy i szybko dostosować swoje strategie, wygrywają. Reszta zostaje w tyle, obok zaspamiowanych farm linkowych i przepełnionych keywordami stron, które kiedyś dominowały wyniki wyszukiwania.